Адрес для входа в РФ: exler.bar

Яндекс таки запустил сервис автоматического закадрового перевода англоязычных видео в Youtube и Vimeo.

Пользователям "Яндекс.Браузера" и в мобильных приложениях стал доступен закадровый перевод видео с английского языка. Поддерживаются как мужской, так и женский голос, сообщается в пресс-релизе "Яндекса".

Перевод происходит в несколько этапов. Сначала ИИ распознает речь, превращает ее в текст и с помощью нейросетей разбивает на предложения. Потом определяет пол говорящего, переводит предложения на русский язык и синтезирует голос. Остается совместить перевод с видеорядом. Это совсем не тривиальная задача, потому что в русском языке предложения длиннее, чем в английском. Здесь на помощь снова приходят нейросети.

Поэтому процесс перевода занимает несколько минут - для этого нужно поставить видео на паузу и подождать. Как только все будет готово, пользователю придет соответствующее уведомление.

Согласно заявлению компании, поддерживаются любые англоязычные видео на YouTube, Vimeo и других популярных платформах. Перевод доступен в "Яндекс.Браузере" для Windows, macOS, Linux и Android и в мобильном приложении для Android и iOS. (Отсюда.)

В Яндекс.Браузере при просмотре англоязычных роликов на соответствующем сервисе появляется вот такая надпись.

Если нажать на кнопку включить, то может сразу пойти автоматический перевод, а может появиться вот такая надпись, и тогда придется подождать, прежде чем перевод будет готов.

Погонял разные ролики. Вообще очень прикольно и прямо-таки впечатляет. Понятно, что лучше всего включать перевод на сольных выступлениях, ну и понятно, что там будет немало всяких огрехов (это совершенно неудивительно), но в общем и целом понять смысл того, о чем говорится - вполне можно. И это круто!

Заметно хуже, когда разговаривают несколько людей и еще друг друга перебивают, но и с таким вариантом сервис более или менее справился.

Я неоднократно читал о различных технологиях улучшения изображений и вообще за этими разработками стараюсь следить - это очень важно и будет востребовано.

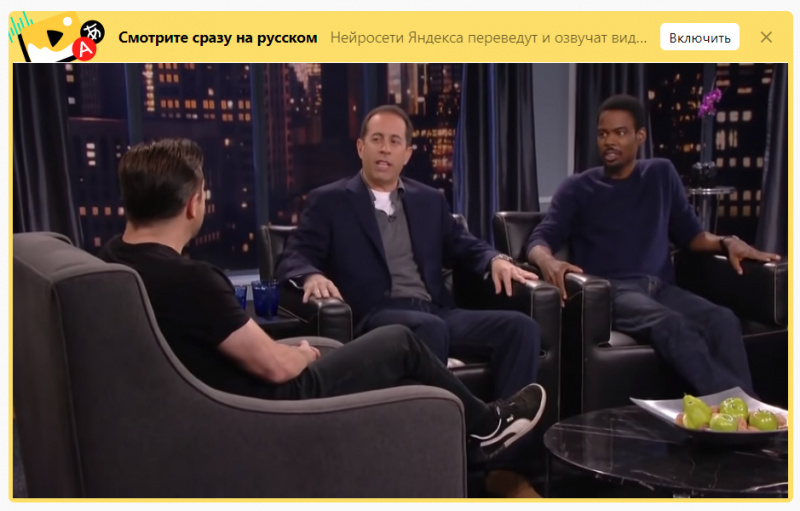

Сейчас корпорация Google объявила о создании новой технологии улучшения изображения, повышающей разрешение картинки аж в 16 раз. Цитирую отсюда.

Разработчики Google представили новую технологию, благодаря которой можно значительно улучшить качество исходного изображения. Искусственный интеллект попиксельно восстанавливает даже сильно сжатую картинку, приближая её к оригиналу.

Команда Brain Team продемонстрировала два алгоритма генерации фотографий. Используя технологию SR3, предусматривающую апскейлинг с помощью повторного уточнения, нейросеть увеличивает разрешение картинки, достраивая недостающие части из гауссовского шума. Обучение этой модели построено на методах искажения изображения и последующем обратном процессе.

Вторая диффузная модель — CDM. Для её обучения специалисты использовали миллионы изображений в высоком разрешении из базы данных ImageNet. Улучшение качества картинки она производит каскадно — в несколько этапов. Так, исходник размером 32х32 пикселя улучшается до 64x64, а затем до 256x256 (в 8 раз), а оригинальное изображение с разрешением 64x64 точки обрабатывается по схожей схеме до 256x256 и 1024x1024 пикселя (масштабирование 16x).

По заверению разработчиков, новая технология превосходит по качеству восстановления фотографий такие современные методы ИИ-масштабирования, как BigGAN-deep и VQ-VAE-2.

На сегодня Google лишь продемонстрировала результаты работы алгоритмов посредством коротких анимаций, но ещё не публиковала подробностей о новой технологии. Когда компания планирует представить коммерческий вариант ИИ-апскейлера, не уточняется.

Выглядит это все очень интересно, но, как обычно, буду ждать, когда предоставят готовый инструмент, с помощью которого я смогу посмотреть, как это работает вживую.

Ну что, это круто, если все так и есть. Жду, когда появится - сравню с aptX HD, AAC и LDAC. Интересно, это вообще можно будет услышать? А то без хорошо прогретой бескислородной меди толком-то и не поймешь!

Qualcomm представила свою новую разработку — кодек aptX Lossless. По заверению компании, его использование обеспечит сторонникам Bluetooth-акустики качество аудио, сопоставимое с прослушиванием CD при классическом проводном подключении.

Представители Qualcomm подчёркивают, что при использовании гаджетов, которые получат поддержку кодека aptX Lossless, их владельцы смогут рассчитывать на значение битрейта до 1,4 Мбит/с. Поскольку пропускная способность самого Bluetooth-канала технически составляет 1 Мбит/с, компании пришлось применить специальную технологию потокового сжатия.

Впрочем, эксперты отмечают, что специально продуманные алгоритмы не приводят к ухудшению качества дорожки. Звук на входе идентичен выходному сигналу — 16 бит / 44,1 кГц (CD-качество). Новый кодек будет входить в состав технологии Snapdragon Sound, представленной в начале весны 2021 года.

Пока что ни одна из выпущенных Qualcomm мобильных платформ не поддерживает новую технологию. Ожидается, что выход на рынок первых смартфонов, совместимых со Snapdragon Sound и aptX Lossless, состоится уже в следующем году. (Отсюда.)

У замечательного Вастрика поразительно интересная (как обычно) статья о машинном переводе: о том, как это все начиналось, как развивалось, что с этим происходит сейчас, какие в этой области существуют прорывы и в чем заключаются проблемы. Кого интересует эта тема - очень рекомендую почитать: Вастрик, как обычно, прочитал кучу различных материалов, чтобы потом изложить все последовательно и понятно. Плюс - он реально хорошо и остроумно пишет, так что читать его - одно удовольствие. Цитировать ничего не буду, там просто нужно читать.

Кстати, должен заметить, что с появлением искусственного интеллекта машинный перевод стал заметно более продвинутым и видно, что это все активно развивается. Если раньше на перевод чего-то чуть более сложного, чем самая простейшая фраза, без слез смотреть было невозможно, то сейчас уже уровень машинного перевода заметно повысился. И машинные переводчики стали неплохо справляться даже со всякими непростыми временами, насколько я могу судить.

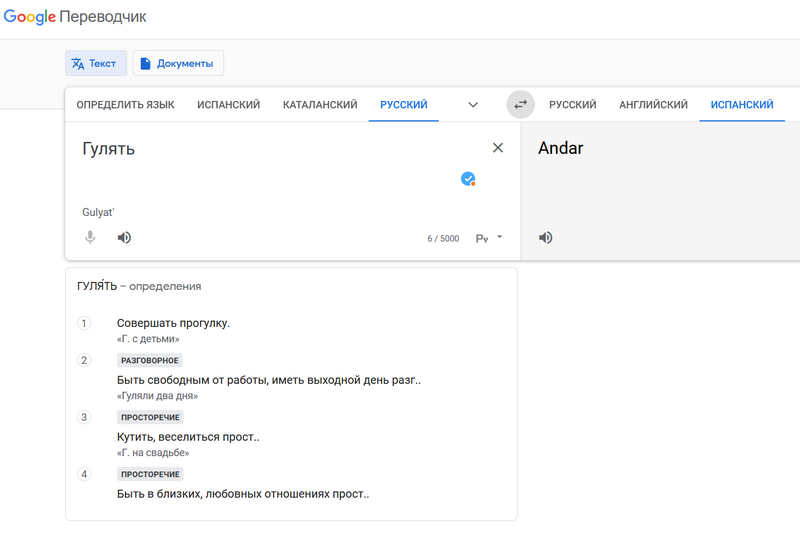

Кстати, что интересно, в моем личном рейтинг Яндекс.Переводчик обгоняет переводчик Google. Да-да, я много раз их сравнивал, и теперь пользуюсь практически только Яндекс.Переводчиком: он, на мой взгляд, более удобный и продвинутый. И дело не только в том, что ЯП определяет язык, на котором ты пишешь и автоматически меняет направление перевода, если это требуется. (Пример. В ЯП выставлен перевод с испанского на русский. Я в испанском разделе начинаю писать на русском - ЯП сам меняет направление перевода и правильно выдает результат.) А переводчик Google такое не умеет делать в упор.

Но у Яндекса также значительно разнообразнее связанные слова и намного разнообразнее реальные примеры употребления, что мне очень помогает.

Вот, сравните.

Остальные сервисы я обычно использую гугловские, особенно поиск. Но в плане автоматического перевода Яндекс тут лично у меня вырвался вперед, как ни странно.

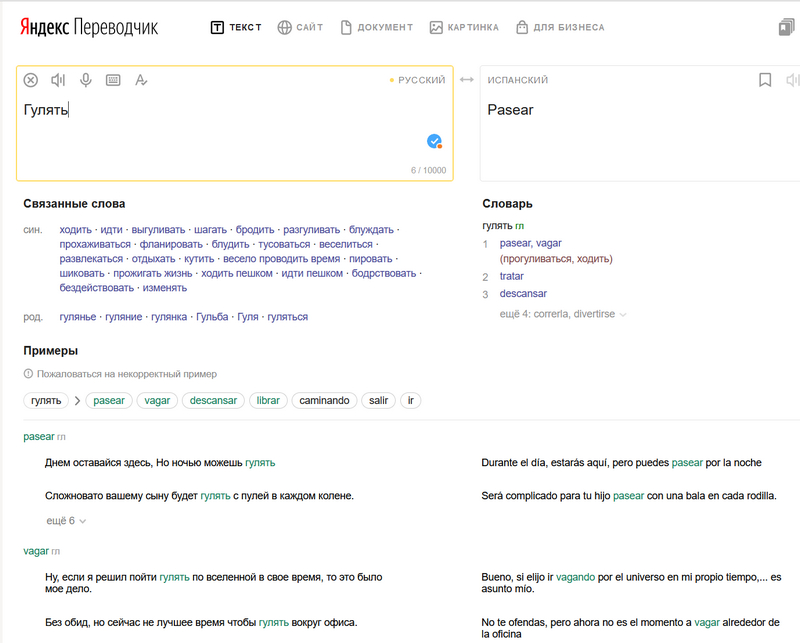

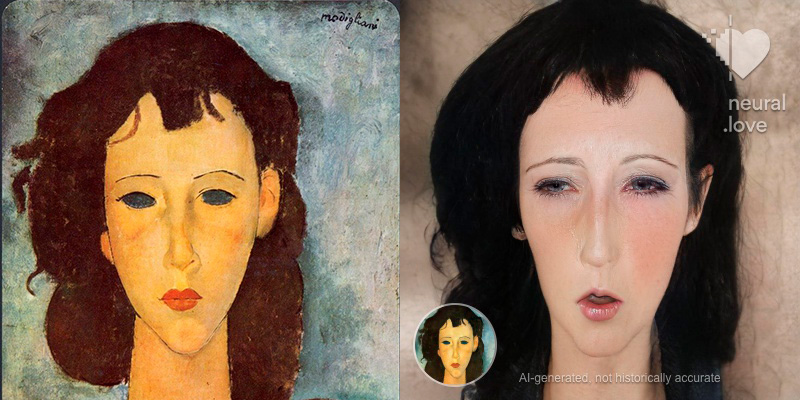

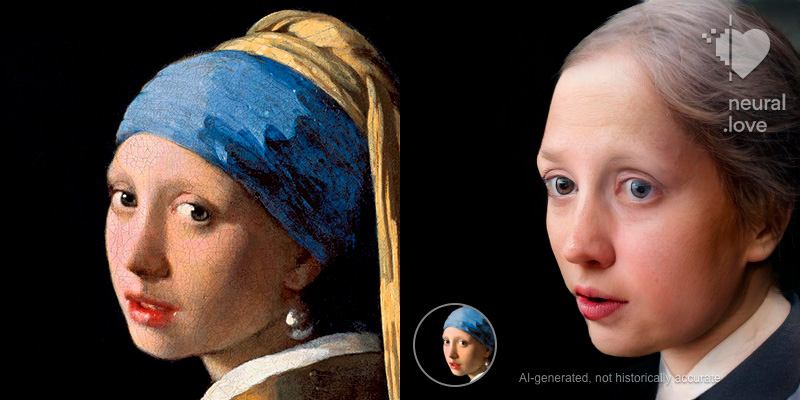

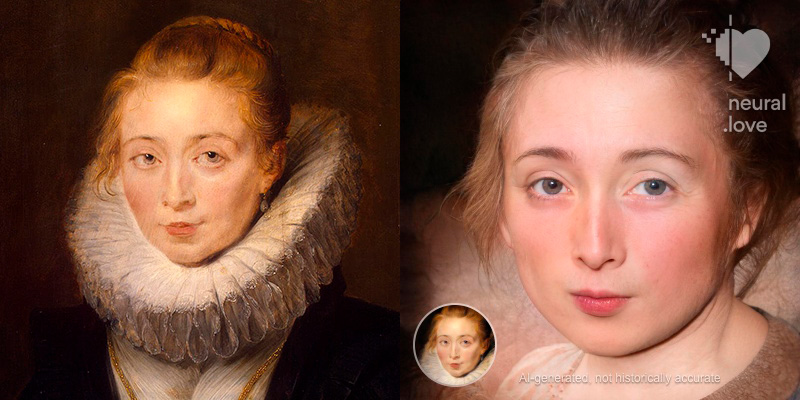

Сервис называется Neural.love. Нейросеть умеет обрабатывать фото и видео, делая реалистичными (как бы фото) рисунки и картинки. Также умеет раскрашивать черно-белые фото, но это не так интересно.

Вот пример фото.

Портреты и картинки - значительно интереснее.

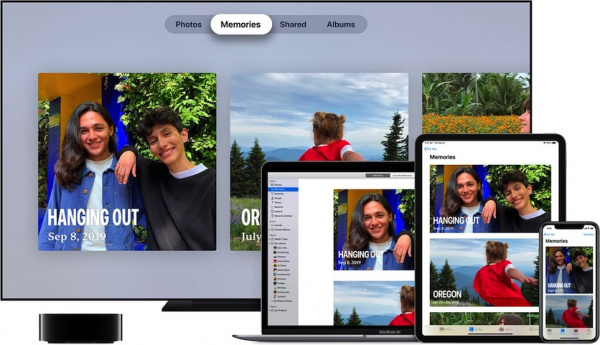

Компания готовится к запуску функции отслеживания снимков в галереях смартфонов на предмет наличия незаконного контента. Сканирование будет проводиться непосредственно на iPhone, но в случае обнаружения подозрительных изображений нейросеть сообщит об этом в Apple. Информацию о нововведении, опубликованную изданием Financial Times, уже подтвердили представители бренда.

По заявлению Apple, фирменный алгоритм neuralMatch позволяет локально сканировать фотографии владельцев iPhone без их отправки на облачные сервера. «Подозрительность» снимков выявляется путём сопоставления с базой данных Национального центра поиска пропавших и эксплуатируемых детей в США, включающей более 200 000 изображений.

С помощью алгоритмов хеширования система пометит сомнительные фото — и если количество отметок достигнет определённой цифры, neuralMatch предупредит Apple о возможном обнаружении незаконного контента. После этого сотрудники компании примут решение об обращении в правоохранительные органы. Схожую систему проверки изображений под названием PhotoDNA уже применяют и другие крупные компании, такие как Facebook, Twitter и Google.

Кроме того, в iOS 15 приложение «Сообщения» будет использовать машинное обучение на устройстве, чтобы предупреждать пользователя, если он намерен отправить конфиденциальный контент. Если гаджетом пользуется ребёнок, его родители также получат оповещение об отправке подозрительных файлов с устройства. При этом, как утверждает Apple, частные сообщения будут нечитаемыми для компании. Вендор сообщил, что система вскоре будет развёрнута в США, но не уточнил, будет ли она запущена глобально и когда это произойдет.

Комментируя нововведение, профессор Университета Джона Хопкинса и криптограф Мэтью Грин отметил, что опасается попадания инструмента в руки мошенников, а сам алгоритм хеширования не исключает генерации ложных результатов. Представители бренда на заявление специалиста не ответили.

Upd: компания подтвердила, что не сможет сканировать изображения на устройствах пользователей, отключивших функцию «Фото iCloud», поскольку отметки о сомнительном содержимом прикрепляются к копиям фотографий в облачном хранилище, а не к оригинальным изображениям. (Отсюда.)

М-да. Рыться в фотографиях пользователя непосредственно на его смартфоне, помечать "подозрительные", а информацию об этих "подозрительных" еще и сливать правоохранительным органам - это, конечно, красиво. Особенно когда знаешь, насколько "эффективно" работают все эти механизмы распознавания и искусственного интеллекта.

Что-то становится все как-то грустнее и грустнее. Нет, есть, конечно, способы этому противостоять, но тенденции как-то совсем не радуют.

Запас хода в 1000 км и зарядка за 5-8 минут. GAC Aion V EV с графеновой батареей готов совершить революцию на рынке?

Китайская компания GAC показала на выставке Technology Day грядущий электромобиль Aion V EV, который в первую очередь впечатляет своей быстрой зарядкой.

Запас хода в 1000 км и зарядка за 5-8 минут. GAC Aion V EV с графеновой батареей готов совершить революцию на рынке?Пока многие мировые бренды только обещают, GAC уже демонстрирует автомобильную зарядку, способную кардинально изменить ситуацию на рынке. По заявлению производителя, в зависимости от версии для зарядки от 0% до 80% будет достаточно 16 или даже всего 8 минут!

Демонстрация касалась кроссовера Aion V EV, который выйдет на рынок уже осенью. Феноменальных показателей удалось добиться благодаря использованию графеновых аккумуляторов.

Если говорить подробнее, то модификация Aion V EV 3С с батареей, обеспечивающей запас хода в 500 км, сможет заряжаться с 0% до 80% за 16 минут, а с 30% до 80% — всего за 10 минут. Модификация Aion V EV 6С сможет похвастаться показателями 8 и 5 минут соответственно, предлагая запас хода до 1000 км.

Во время демонстрации зарядное устройство показало мощность 481 кВт. При этом GAC утверждает, что такие показатели никак не сказываются на надёжности аккумулятора, и он должен обеспечить до 1 млн пробега, правда, при комнатной температуре. (Отсюда.)

Зарядка за 8 минут и запас хода до 1000 километров - это очень интересно, да. Но показы на выставке - это одно, а реальная эксплуатация - совсем другое. Подождем, когда появятся в продаже и когда станет известно реальное положение дел.

Слушайте, это реально гениальная идея! Задрали владельцы собак, которые не убирают за своими питомцами! А не убирают очень многие и есть твари, которые не убирают за собакой, даже когда она наделала во дворе, где играют дети. (Лично видел одного такого дедка-каталана, который даже после замечания дерьмо его собаки убирать не стал.) С введением же подобных штрафов все станут убирать как миленькие! Очень надеюсь, что Испания последует этому замечательному примеру.

Власти Израиля создадут базу собачьих фекалий. Это не шутка — такая база позволит собирать ДНК четвероногих и штрафовать их владельцев.

В Тель-Авиве чиновники устали получать тысячи жалоб на неубранные собачьи экскременты в общественных местах, поэтому какой-то злой гений придумал и протолкнул революционную схему: чтобы избавить город от фекалий, нужно их собирать, проводить ДНК-тестирование и забивать полученные образцы в базу.

Дальше начинают крутиться бюрократические механизмы. В Израиле запрещено держать дома собаку без специальной лицензии, но недавно на фоне борьбы с фекалиями к этому закону в Тель-Авиве приняли поправку. Теперь для продления или получения новой лицензии жителям города необходимо сдать генетические данные питомца.

Таким образом, специалистам останется лишь сопоставить ДНК, полученные из фекалий, с имеющейся базой. В случае совпадения владелец четырёхлапого получит письмо с требованием оплатить штраф и покрыть стоимость ДНК-теста — в сумме получается 472 шекеля, или 10,7 тыс. рублей. (Отсюда.)

Я бы эту новость и перепечатывать не стал - о разработках неинвазивных глюкометров время от времени сообщается давно, а серийных устройств до сих пор как не было, так и нет, - однако здесь утверждается, что вот прямо-таки завод уже строится, и что с 2023 года начнут выпускать серийно.

Данный глюкометр уровень сахара определяет по слюне. Что звучит совсем странно, конечно. Мне не очень понятно, как по слюне вообще можно определить уровень сахара в крови. Но в заметке говорится именно это.

Физик Пол Дастур из Университета Ньюкасла создал биосенсор для диагностики уровня сахара в крови. В отличие от существующих методов, его прибор не требует болезненного прокалывания пальца, что позволит улучшить качество жизни сотням миллионам людей с диабетом по всему миру.

Тест на диабетИдея создания подобного устройства пришла к Полу, когда он заглянул на работу к своей жене. Она работает учительницей в начальной школе и вынуждена делать нескольким малышам болезненные уколы перед каждым приёмом пищи. Так Пол узнал, что больше 460 миллионов человек по всей планете регулярно проверяют свой уровень глюкозы. Результатом многолетних исследований стал биосенсор, похожий на пластинку жевательной резинки. Он способен проводить диагностику сахара на основе слюны человека.

Главное, что это не очередная разработка, которая не пойдёт дальше подобных новостей. Строительство фабрики по массовому производству биосенсора стартует уже в текущем году, а первые датчики сойдут с конвейера в 2023-м. Автор проекта уверяет, что в будущем биосенсор можно использовать для анализа 130 различных показателей, в том числе онкомаркеров, гормонов и различных аллергенов. Кроме того, он может стать основным инструментом для диагностики коронавируса. С этой целью были подключены исследователи из Института биологической инженерии Висса при Гарвардском университете. (Отсюда.)

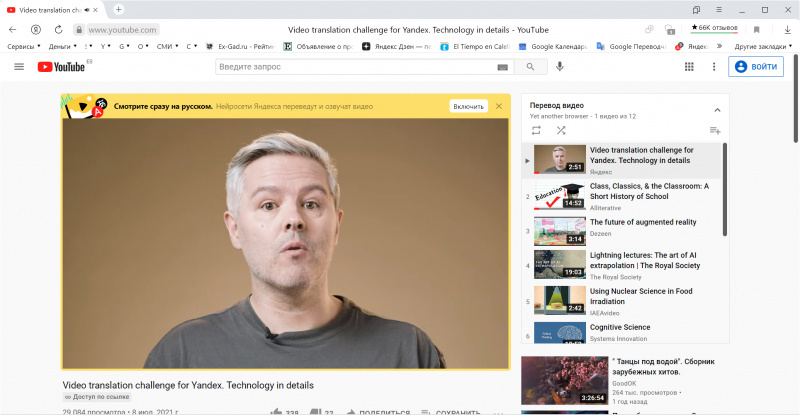

Читаю новость о том, что в "Яндексе" создали "не имеющую аналогов в мире технологию автоматического перевода видеороликов".

«Яндекс» создал технологию машинного перевода видео. С ее помощью видеоролики зарубежных авторов смогут посмотреть даже те, кто не владеет иностранными языками – разработка «Яндекса» в автоматическом режиме переведет видео на русский язык и озвучит его закадровым голосом. Об этом CNews рассказали представители компании. По заявлению создателей, технология не имеет аналогов в мире.

На сегодняшний день у «Яндекса» готов прототип системы машинного перевода. Сейчас он работает только с роликами на английском языке. Разработчики утверждают, что опробовали технологию на видеозаписях на самые разные темы: изменение климата, машинное обучение, история Плутона.

Пользователям функция машинного перевода видеороликов доступна в фирменном браузере «Яндекса» для операционных систем Windows и macOS, однако лишь при просмотре ограниченного числа роликов. Специалисты компании создали на Youtube-канале "Yet another browser" подборку из 12 видео (плейлист «Перевод видео»), с помощью которых любой желающий сможет убедиться в работоспособности технологии. В ближайшее время пользователи получат возможность самостоятельно выбирать, какие именно ролики переводить, обещают в «Яндексе».

Над созданием прототипа работало несколько команд. Сейчас в нем применяются технология синтеза речи, разработки «Яндекс.переводчика» и биометрия. Последняя используется для определения пола говорящего – это, как отмечают в «Яндексе», важно и для перевода, и для синтеза речи, в частности, позволяет подобрать подходящий голос для закадровой озвучки.

Технология «Яндекса» поддерживает синхронизацию закадрового голоса с видеорядом, при необходимости корректируя темп речи виртуального переводчика и добавляя в нее паузы. Синхронизация необходима, поскольку исходные и переведенные реплики могут значительно отличаться по длительности – например, в английском языке часто используемые фразы нередко лаконичнее своих русских аналогов.

Для тех, кто внимательно следит за тем, что происходит в мире машинных переводов, все это звучит совершеннейшей фантастикой. Обычные-то текстовые переводчики пока, мягко говоря, далеки от совершенства (хотя нельзя не признать, что с каждым годом они работают все лучше и лучше - благодаря нейросетям), а уж автоматическое воспроизведение текста голосом - это все слушается очень криво.

А тут нам утверждают, что они научились не только распознавать голос в ролике, не только качественно переводить его на другой язык, но и озвучивать на другом языке? Мне в это верится с большим трудом.

Компания предлагает послушать типа как "образцы работы технологии". Сделать это можно только в Яндекс.Браузере, для чего я его поставил, в нем в Yotube открыть плейлист "Перевод видео", и там можно включить перевод.

Для тех, кому не хочется со всем этим возиться - ставить Яндекс.Браузер и так далее, - я заснял небольшой ролик о том, как это все работает.

Так вот. То, что я вижу и слышу в ролике - это даже рядом никакой не "автоматический перевод". Это перевод, явно сделанный профессиональным переводчиком и озвученный профессиональным актером (безусловно, живым человеком, это даже рядом не автоматическая озвучка, как в ридерах с такой функцией).

Ну и в чем юмор, ребята? Ну сделали вы войсовер для нескольких роликов, молодцы. Но на черта это выдавать за "автоматический перевод", когда там за версту понятно, что это никакой не автоматический перевод?

Если вы работаете над этой технологией, но пока вам нечего показать - ну так и напишите, что работаете, но показать пока нечего.

Если вы создали подобную технологию, она работает, и вы готовы ее продемонстрировать - ну так разрешите ее использовать для любых роликов, оговорив, конечно, что голос человека в ролике должен быть только один. Тогда хоть можно будет понять, что она собой представляет.

А так - вообще не пойми что. Показывать обычный войсовер в качестве "демонстрации технологии автоматического перевода" - это как-то очень и очень странно.

На выставке MWC в Барселоне показали новый смартфон Concept Phone 2021. Это концепт, что прямо-таки следует из названия, в серии он выпущен не будет, однако это полностью рабочая версия, и компания разослала несколько экземпляров данного смартфона известным техноблогерам.

Что интересного в этом смартфоне?

Во-первых, его задняя крышка может менять свой цвет.

Помимо уникального рисунка в виде надписи NOW, задняя крышка выполнена с применением электрохромной и электролюминесцентной технологий. Благодаря этому поверхность способна менять цвет. Например, при входящем звонке она меняется с серебристого на синюю, а во время зарядки центральная область заполняется зелёным и мигает.

Это любопытная история, конечно.

Во-вторых, смартфон поддерживает зарядку аж в 160 Ватт. Производитель заявляет, что с 0 до 100% смартфон зарядится за 10 минут.

На канале Tech Spurt это проверили, вот ролик. 10 минут не получилось, но получилось 13 минут 10 секунд - и это реально очень круто!

Сам смартфон в серию запущен не будет, но в компании сказали, что данные технологии будут использованы в каких-то других смартфонах компании.

Да-да, именно перелет, и это неимоверно круто!

Летающий автомобиль AirCar совершил первый в истории для подобного типа транспортного средства междугородный полёт.

35-минутный полёт из Нитры в Братиславу был совершён 28 июня. Расстояние между этими городами составляет 96 км, что с учётом встречающихся населённых пунктов выливается примерно в 1 час езды на автомобиле. Лететь на автомобиле, как видим, почти вдвое быстрее.

На видео также запечатлён процесс трансформации AirCar из самолётного состояния в автомобильное. Это занимает около трёх минут.

В текущем виде AirCar Prototype 1 оснащается двигателем BMW мощностью 160 л.с. Имеется и парашют. Машина уже показала способность летать на высоте до 2500 м со скоростью до 190 км/ч.

AirCar Prototype 2 получит двигатель мощностью уже 300 л.с. и сертификат EASA CS-23. Такой аппарат сможет двигаться в воздухе со скоростью до 300 км/ч при дальности полёта до 1000 км. (Отсюда.)

Ну и вот ролик трансформации и полета. Прям будущее уже здесь!

Давно слежу за этой историей - созданием культивируемого мяса, то есть не заменителя мяса на основе растительной пищи, а натурального мяса, выращенного из клеток животных. Раньше данный процесс был очень дорогим, и цена конечного продукта была совершенно неподъемной, но вот теперь сообщают о том, что разработчикам из Future Meat удалось снизить стоимость до $20 за килограмм, что уже более или менее приемлемо.

Израильский стартап Future Meat Technologies объявил о запуске первого в мире коммерчески жизнеспособного предприятия по производству искусственного мяса. Future Meat построил линию для быстрого изготовления крупных партий мяса — стартап предлагает своим клиентам курицу, свинину и баранину. До конца этого года продукты Future Meat появятся в американских ресторанах, а в следующем году их стоимость упадет до $2 за 100 граммов.

Культивируемое мясо Future Meat — это не искусственный заменить мясных продуктов, собранный из растительных ингредиентов. Компания берет за основу несколько клеток реальных животных, а затем стимулирует их рост в специализированных инкубаторах. На выходе появляются полноценные куски мяса, неотличимые по своей структуре от стандартных продуктов и не требующие убоя животных.

«С самого начала все наши усилия были сосредоточены на масштабировании производства и снижении затрат, чтобы мы могли получить коммерчески жизнеспособный продукт. История здесь заключается не в том, чтобы получить премиальный продукт. Речь идет о поиске альтернативного способа производства мяса», — объяснил гендиректор Future Meat Ром Кшук.По словам Кшука, Future Meat удалось сократить стоимость получения искусственного мяса до $4 за 100 граммов — изначально производство было два раза дороже. И стартап не собирается останавливаться — в течение двух лет цена на продукты Future Meat упадет до $2 за 100 граммов. Таким образом компания обещает сделать покупку мяса без убоя не менее выгодным предложением, чем приобретение традиционного мяса.

Предприятие Future Meat универсально — стартап производит культивируемую курицу, свинину и баранину, а в ближайшем будущем начнет поставлять и говядину. Производственная мощность — 500 килограмм в день. Первый завод располагается в израильском городе Реховот, а второй может появиться в США — с этой целью стартап сейчас ведет переговоры с американскими регуляторами. Future Meat также обсуждает возможность поставок своих продуктов в американские рестораны, начиная с четвертого квартала 2021 года. (Отсюда.)

В издании Deep-Review.com - обзор умных весов Huawei Scale 3. Самое интересное в этом обзоре - подробное описание сути биоимпедансного анализа и того, какие именно параметры организма и каким образом эти (и другие) умные весы могут получать. Кому интересно знать, что это и откуда берется - почитайте.

Биоимпедансный анализ на Huawei Scale 3

На точность биоимпедансного анализа влияет множество факторов1, включая:

Обезвоживание организма. Это увеличивает электрическое сопротивление тела и ведет к значительной переоценке процента жира

Измерение после приема пищи или воды. Это может давать погрешность более 4% при измерении жира в организме

Физическая активность перед взвешиванием. Умеренные упражнения снижают электрическое сопротивление тела. Например, взвешивание сразу после 90-минутного упражнения средней интенсивности может завысить безжировую массу на 12 кг. Поэтому взвешивание нужно делать спустя несколько часов после тренировокЛучшее время для взвешивания — сразу после пробуждения. Таким образом вы исключаете многие негативные факторы.

Что касается непосредственно Huawei Scale 3, весы «измеряют» 11 показателей:

Вес

Индекс массы тела

Доля жира

Безжировая масса

Скелетная мышечная масса

Процент содержания воды в организме

Белок

Минеральный состав костей

Уровень висцерального жира

Базальный метаболизм

ПульсСлово «измеряют» написано в кавычках, так как в реальности весы измеряют при помощи электродов только один показатель — объем жидкости в организме (не считая пульса, который не имеет никакого отношения к составу тела).

Все остальные параметры вычисляются на базе этого показателя при помощи фирменного алгоритма Huawei TruFit.

Утверждается, что это самая большая в мире сферическая панорама Нью-Йорка. Увеличивайте масштаб при просмотре (колесом мышки или пальцами на смартфоне) - детализация там просто фантастически. Не очень понятно, как они вообще ухитрились это снять. .

Куда катится этот мир?! В Испании сделали робота для приготовления паэльи - "Robot that can cook a paella is causing quite a stir in Spain".

Этот робот, недавно представленный на выставке, производства компании br5 (Be a Robot 5 - это название робота из фильма "Короткое замыкание") демонстрировал, как он готовит паэлью из соответствующих ингредиентов (соус софрито, рис, бульон и морепродукты) на установке для приготовления паэльи компании Mimcook.

Разумеется, сам робот и его создатель 41-летний промышленный инженер Энрике Лилло, подверглись серьезной критике разгневанной общественности, которая заявила, что приготовление культового для всей Испании блюда каким-то роботом - это подрывание нравственных основ, духовных скреп, да и вообще - #кудакатитсяэтотмир!

Инженер же заявил, что раз люди используют электрическую выжималку для получения апельсинового сока, то не очень понятно, почему нельзя использовать другой аппарат для получения вкусной паэльи.

И Лилло даже заявил, что его робот, в отличие от живого человека, во время приготовления паэльи не отвлечется на сообщение по WhatsApp, а будет равномерно помешивать готовящийся рис.

Разработчик также заявляет, что робот - многофункциональный, и он может делать далеко не только паэлью, но также жареную картошку, гамбургеры, пиццу и так далее: ему лишь нужно предоставить нужные ингредиенты и соответствующий инструмент (плита, духовка), после чего включить нужную программу.

Также Энрике признался, что пробовал паэлью, приготовленную его роботом, и он был просто поражен тем, какой вкусной она получилась. Ни одна бабушка Консепсьон, ни один дедушка Юсбайо такую паэлью не сделают, кощунственно добавил Лилло.

P.S. При слове "роботизированная рука" в памяти тут же всплывает шикарный эпизод из "Теории большого взрыва".

Офигенное видео - Железный человек на службе Королевской морской пехоты Великобритании.

Это совместные испытания разработки компании Gravity Industries, которую создал британец Ричард Браунинг, он же и разрабатывал этот костюм.

С помощью технологии Deepfake наложили лицо нынешнего Майкла Джея Фокса на лицо его персонажа из "Назад в будущее II". И по ролику видно, насколько классно тогда поработали гримеры - почти один в один, фантастика просто!

Сайт для создания генеалогического древа MyHeritage добавил на своей странице технологию Deep Nostalgia, которая с помощью искусственного интеллекта "оживляет" фотографии.

Выглядит это все любопытно, однако для получения более или менее интересного результата нужно, чтобы выполнялись следующие условия:

- лицо должно быть строго анфас (положение "две трети" уже обрабатывается намного хуже);

- очень желательно, чтобы человек на фото не улыбался (улыбку плоховато обрабатывает, да и смотрится неестественно);

- если результат не устраивает, то можно выбирать вид анимации, коих там 10 (что-то получается лучше, что-то хуже);

- для анимаций, где человек слегка поворачивает голову, желательно, чтобы у него были длинные волосы (с короткой прической алгоритм ожидаемо не сможет обработать торчащие уши).

А так вообще поиграться было интересно.

Экслериха у него получилась лучше всех.

Следующие два - пришлось подбирать вид анимации: с короткой стрижкой при повороте головы "плыли" уши.

Ну и вот тут пробовал, что именно получится, когда на лице улыбка.

Вообще это, конечно, потрясная история с посадкой марсохода Perseverance.

Вот запись стрима NASA - для тех, кто еще не посмотрел.

Как сообщила руководитель планетологического подразделения NASA Лори Глейз, ученые уже начали работу. Они, в частности, анализируют присланные снимки. По словам Глейз, установленные на марсоходе научные инструменты будут активированы в ближайшие несколько недель.

Специалист уточнила, что в течение нескольких дней эксперты NASA рассчитывают ознакомиться со всеми данными о посадке. Они могут начать поступать уже в ближайшие часы. Речь идет о кадрах и аудиозаписях, которые были сделаны во время спуска аппарата. "У нас впервые появится такая возможность", - подчеркнула Глейз.

В первые несколько земных суток главной задачей марсохода будет настройка программного обеспечения и оборудования, в том числе систем для передачи данных на Землю. Кроме того, аппарат сделает панорамные снимки, чтобы уточнить характеристики местности. Позже, как ожидается, марсоход совершит несколько коротких поездок – примерно на 5 м и обратно.

В течение примерно трех недель специалисты NASA планируют выбрать место для проведения испытаний закрепленного на марсоходе вертолета Ingenuity. С его помощью, в частности, планируется делать фотографии поверхности Марса. Ожидается, что Ingenuity совершит первый полет весной.

Когда все проверки будут завершены, марсоход приступит к поискам следов существования в прошлом жизни на Красной планете. По словам главного научного специалиста проекта Кена Фарли, аппарат, вероятно, в конечном счете будет двигаться в северо-западном направлении от места посадки. Perseverance должен осуществить сбор образцов грунта, в частности, в местах, где когда-то было озеро. (Отсюда.)

Сергей Ёлкин на это волнующее событие, конечно, не мог не откликнуться.

P.S. Ролик (частично мультик), который наглядно показывает механизм посадки.

Слушайте, какая интересная разработка! И мощность 5 Ватт - в общем-то, вполне пристойная.

Xiaomi провела презентацию технологии беспроводной зарядки Mi Air Charge для смартфонов и другой цифровой электроники, включая умные часы и фитнес-трекеры. В отличие от традиционных беспроводных док-станций, требующих прямого контакта с гаджетом, новая разработка компании способна осуществлять «дозаправку» других устройств на расстоянии до нескольких метров.

Устройство представляет собой стационарный прибор, сопоставимый по габаритам с очистителем воздуха. Он получил пять внутренних антенн с многопозиционной фазовой манипуляцией для определения местоположение смартфона и 144 беспроводных зарядных элемента, которые посредством формирования луча передают волны миллиметрового диапазона на заряжаемые устройства.

Продемонстрированный прототип Xiaomi Mi Air Charge, по заверению производителя, имеет выходную мощность 5 Вт, причём обеспечивает её сразу для нескольких смартфонов в радиусе действия. При этом физические препятствия, как утверждает вендор, не снижают эффективность зарядки. Ожидается, что в дальнейшем док-станция будет совместима с другими устройствами, включая наушники и умные часы.

Xiaomi подтвердила, что на текущем этапе разработки новинка представлена лишь для демонстрации технологии. Для запуска устройства в производство оно должно пройти ряд испытаний с последующим согласованием в регулирующих органах. Его розничный дебют, по словам представителей компании, состоится не раньше 2022 года.

Некоторое время назад я писал обзор PocketBook 633 Color - цветного ридера на E-Ink Kaleido.

Георгий Киселёв купил цифровой микроскоп и с его помощью исследовал, как работает эта матрица - "Цветные электронные чернила E-Ink Kaleido под микроскопом".

Было очень интересно почитать.

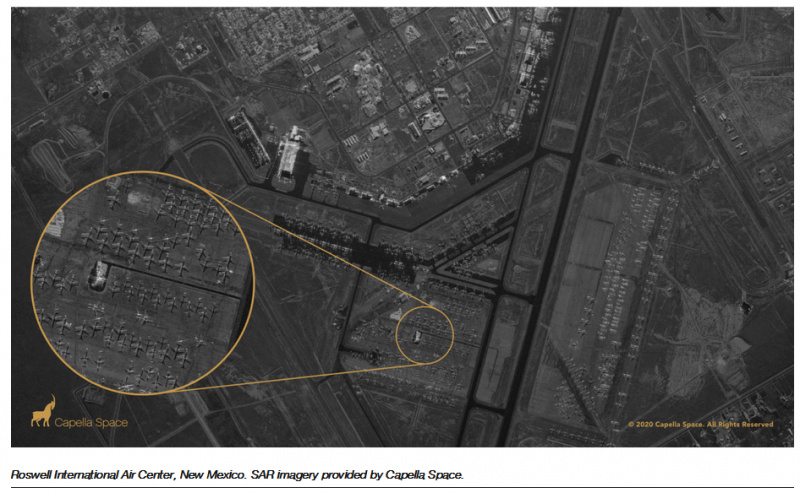

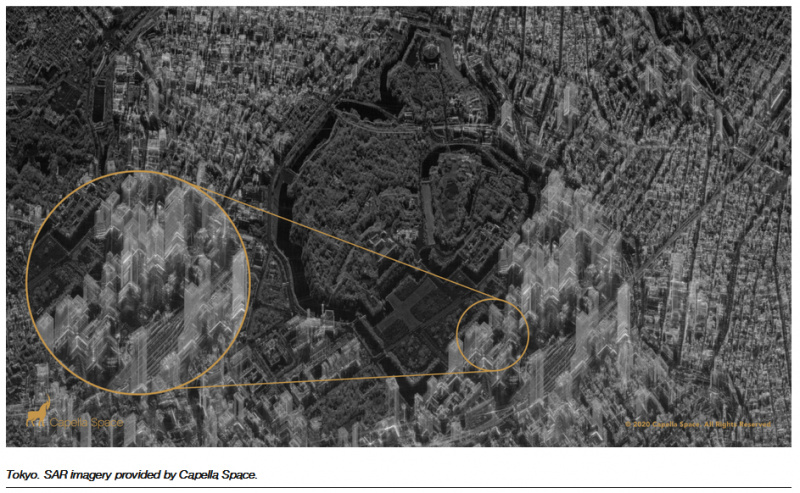

Как интересно-то - "A New Satellite Can Peer Inside Buildings, Day or Night".

Кратко. Американская компания Capella Space с помощью своего спутника может получать сверхчеткие изображения участков Земли. Сейчас в их снимках пиксель равен квадрату размером 50 на 50 сантиметров, но в скором времени они планируют получать снимки с разрешением 25 на 25 и даже 20 на 20 сантиметров. Один и тот же объект спутник может снимать на протяжении от 20 до 60 секунд.

Самое интересное заключается в принципе формирования изображения. Здесь не используются обычные камеры. Изображение получается с радара, который отправляет в нужную точку мощный радиосигнал, а потом обрабатывает полученные данные. И так как это радиосигнал, то съемку можно делать и сквозь облака, и ночью. Также радиосигнал способен проникать через стены зданий, так что со спутника в буквальном смысле слова можно увидеть то, что происходит в кабинетах.

Цели у компании - чисто коммерческие. Самые четкие изображения они имеют право продавать только правительственным агентам США, однако менее четкие изображения они могут продавать как государственным, так и частными клиентам.

У Петра Чернышова (бывший президент компании "Kyivstar") интересный пост по поводу технологии 5G.

5G - огромные ожидания и неприятная реальность

Я знаю, что население многих стран ждет прихода 5G как чуда - которое позволит много всего улучшить. Недавний запуск iPhone 12, который поддерживает 5G - конечно увеличивает оптимизм.

Те битвы, которые ведет сейчас Трамп и вообще Америка с компанией Huawei и в целом с Китаем (именно по поводу 5G) - вроде как говорят что от этой технологии зависят судьбы всей планеты - ну или как минимум Западной цивилизации.

Так вот - я хочу доставить вам всем неприятную новость. Все очень грустно с 5G.

Если кратко:

1. 5G нужно только производителям оборудования (читай Huawei и Ericsson нашего мира)

2. Клиентам - то есть нам с вами - это не нужно вообще

3. Телеком операторы могут сильно пострадать от финансовых последствий этой технологии, если будут вести себя слишком агрессивноРасскажу вам про Китай...

В этой стране решили внедрить 5G быстро и агрессивно. Под громкую музыку Компартия Китая объявила что это самый важный проект страны и запустили его в сентябре 2019 года. Одни из первых в мире!

И на сегодня в стране уже 410 тысяч базовых ТОЛЬКО 5G станций. (Для сравнения - в Украине всех базовых станций на сегодня примерно 40 тысяч)

Начну с того, что в августе 2020 года один из трех больших китайских операторов объявил, что с 9 вечера до утра будет ВЫКЛЮЧАТЬ свои 5G базовые станции - потому что почти никто их не использует. Остальные два оператора вскоре сделали то же самое. Неожиданно?

С этой технологией есть две большие проблемы. Первая - в городах станцию надо строить через каждые примерно 200-300 метров - чтобы был хороший сигнал. Причина - чем выше частота волны - тем меньше дальность покрытия. Чтобы достичь такого же покрытия как сейчас есть у 4G - надо всего им построить примерно 10 млн станций 5G на страну. И эта проблема всем была известна и понятна - производители оборудования заранее потирали свои ладошки ожидая огромных продаж.

Вторая проблема (о ней почему-то никто заранее не подумал) - технология работает так, что станция 5G потребляет примерно в три раза больше электричества чем станция 4G. В начале операторы решили, что с развитием технологии как-то найдутся способы радикально уменьшить потребление электричества - но ОБЛОМ! Поэтому, подсчеты в Китае показывают, что если построить 10 млн станций, то тотальный счет за электричество будет примерно 29 млрд дол в год - что в 10 раз больше годовой прибыли лидера рынка.

По этим двум причинам - никто сейчас не торопится строить много станций 5G. Ведь реальные бенефиты от них пока что непонятны. Кроме того что клип из Интернета загрузится к вам на телефон в 3-5 раз быстрее чем на 4G. Ну и что?

5G - это такое классическое в бизнесе SOLUTION IN SEARCH OF A PROBLEM - то есть технологическое решение уже есть - а проблему которую оно решает - пока что не придумали.

Недавний опрос в Китае показал что 73% населения не понимает зачем им 5G технология и не собирается покупать новый смартфон с ней.

А что сделали операторы? Правильно - обратились к Правительству с просьбой субсидировать их затраты на электричество. И я не исключаю что в Китае могут на это пойти - чтобы не потерять имидж лидера в новых технологиях.

А вот теперь примените все что написано все что написано выше для ситуации бедной страны. И успокойтесь на тему 5G. Его у нас долго не будет!

Любопытная какая заметка. Оказывается, возможно, скоро появится приложение для смартфона, которое с высокой вероятностью сможет определять носителя коронавируса по кашлю.

Технология уже доказала свою эффективность и теперь ученые работают над мобильным приложением, чтобы любой человек мог покашлять в смартфон и получить диагноз. Результат доступен мгновенно, поэтому простой инструмент можно будет использовать в местах массового скопления людей для предотвращения рисков бессимптомной передачи, надеются авторы.

Основой нового диагностического инструмента стал алгоритм, который ученые из Массачусетского технологического института разрабатывали для определения признаков болезни Альцгеймера. Данное заболевание связано с нервно-мышечной деградацией и с помощью ИИ ученые стремились оценивать по речи и кашлю ослабление голосовых связок.

Они достигли высоких результатов в этом отношении, но пандемия COVID-19 заставила ученых посмотреть на свою разработку с другой стороны. Стало понятно, что некоторые пациенты с COVID-19 могут испытывать схожие неврологические симптомы, поэтому алгоритм решили адаптировать для диагностики коронавирусной инфекции.

Данные собирали онлайн. Любой желающий мог заполнить анкету и отправить аудиозапись своего кашля и речи независимо от наличия установленного диагноза COVID-19. Различия в кашле невозможно расшифровать человеку, однако ИИ смог точно определять и классифицировать все случаи.

ИИ с 98,5% точностью идентифицировал по кашлю пациентов с COVID-19, в том числе 100% бессимптомных носителей SARS-CoV-2.

Постановка диагноза базировалась на четырех биомаркерах по аналогии с обследованием при болезни Альцгеймера — силе голосовых связок, эмоциональному тону речи, характеристикам дыхания и мышечной деградации.

«Мы думаем, что воспроизведение звуков меняется при наличии COVID-19 даже если не наблюдается симптомов», — объясняют ученые особенности анализа ИИ.

В настоящее время команда работает над созданием бесплатного приложения для предварительного тестирования на COVID-19. Например, перед походом в ресторан, офис и другие общественные места. В более отдаленной перспективе они рассматривают интеграцию ИИ в динамики смартфона или другие устройства, чтобы система в фоновом режиме могла ежедневно сообщать о рисках бессимптомного носительства.

Изучая причины бессимптомной формы COVID-19, ученые из Дании предположили, что это происходит из-за способности коронавируса маскироваться от иммунных клеток в организме человека. (Отсюда.)

Роботы BostonDynamics уже паркур исполняют. Это вам не рогозинский робот Федя, которого просто чтобы включить, надо по башке гаечным ключом офигачить.

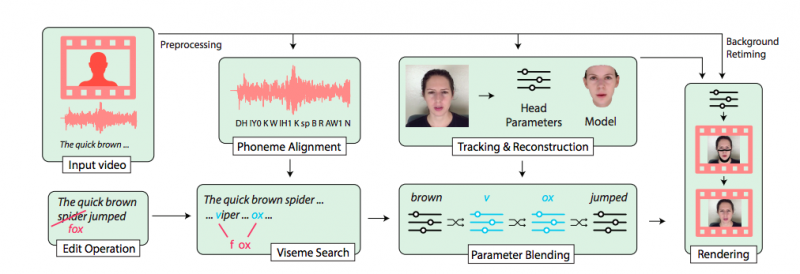

Исследователи из Стэнфордского и Принстонского университетов создали алгоритм, который искажает речь человека на видео. Для убедительности программа не только подстраивает голос, но и изменяет мимику, а также длину ролика.

Как рассказали разработчики, устроена их программа так: из ролика она выделяет аудиодорожку, разделяя речь человека на фонемы. Далее ПО создает 3D модель лица человека, сканируя, как он двигает губами, произнося слова. Затем машина находит висемы — звуки, которые выглядят одинаково при движении губ — и использует их для создания мимики под новые фразы. В итоге из двух произнесенных слов алгоритм создает третье.

Чтобы отредактированный голос больше походил на речь модели, исследователи пользуются программой VoCo, которую они представили в 2016 году. Проанализировав небольшой монолог человека, она способна «спародировать» его голос.

В ознакомительном ролике исследователи показали демоверсию разработки. Например, одного диктора они «заставили» говорить French toast вместо Napalm в предложении I love the smell of napalm in the morning. Другого диктора и вовсе лишили одного слова — программа также умеет удалять речь из ролика. (Отсюда.)

М-да... Deep Fake может на видео заменить лицо человека на другое. Эта программа может заставить человека говорить то, чего он не говорил.

Ну и как после этого верить каким-то видеодоказательствам?

Любопытная статья на сайте Стэнфорда - "Stanford develops ‘autofocals’ – glasses that track your eyes to focus on what you see".

Кратко. Группа Стэндфордских разработчиков создала очки с автофокусировкой. Они представляют собой две наполненные жидкостью линзы, которые могут менять форму, а соответственно - диоптрии. В очки встроены датчики слежения за глазами, которые определяют, на что человек в данный момент смотрит и, соответственно, при этом корректируются характеристики линз.

Есть такая противная штука, которая называется пресбиопия - это когда с возрастом хрусталик глаза теряет эластичность и плохо фокусируется на близких предметах. А если у человека еще и близорукость, то это создает большие проблемы: ему понадобятся одни очки для дали, другие для близи. Я эту штуку как раз к пятидесяти годам заработал, так что хорошо знаю, насколько это все неприятно.

Хороший способ решения данной проблемы - очки с так называемыми прогрессивными линзами: у них верхняя зона с одними диоптриями предназначена для дали, а нижняя с другими диоптриями - для чтения. (Вот здесь можно почитать всякие подробности.)

Я очки с прогрессивными линзами ношу несколько лет, в них себя чувствую вполне комфортно, а недостаток у таких очков только один - высокая стоимость. Например, нынешние мои очки с учетом еще и недешевой оправы обошлись почти в €800.

Кстати, в вышеуказанной статье о прогрессивных очках какую-то явную чушь пишут, перевожу:

Представьте, что вы ведете машину и смотрите в боковое зеркало, чтобы сменить полосу движения. У прогрессивных линз периферийный фокус почти отсутствует. Водитель должен переключиться с того, чтобы смотреть на дорогу и повернуть голову почти на 90 градусов, чтобы увидеть ближайшее зеркало через нижнюю часть линз.

Я не знаю, может быть, существуют какие-то прогрессивные линзы, у которых отсутствует периферийный фокус (что само по себе звучит бредом), но у всех моих очков с прогрессивными линзами с периферийным фокусом все было прекрасно и за зеркалами в машине я без проблем слежу, не поворачивая головы.

Но вернемся к устройству. В любом случае разработка очень интересная, и если они смогут сделать это в формате обычных очков - будет здорово. Но пока такая установка выглядит, как написано в статье, как очки виртуальной реальности, то есть они очень громоздкие.

Это, конечно, совершенно потрясающая история.

Компания SpaceX осуществила 24 мая запуск ракеты-носителя Falcon 9 с 60 спутниками в рамках своей программы глобального широкополосного интернета Starlink.

Как сообщается в твиттере SpaceX, все спутники были успешно развернуты. Основатель SpaceX Илон Маск сообщил, что все космические аппараты находятся онлайн.

Ракета Falcon 9 доставила на орбиту груз общей массой 18,5 тонны. Это самая большая масса груза для ракет этой модели. (Отсюда.)

Очень интересно посмотреть, как это все будет функционировать. Потому что если с приемом спутникового интернета все более или менее понятно, то обратная связь на данный момент требует и здоровенной тарелки, и ее четкой ориентации, и достаточно дорогого оборудования. Но раз они уже разворачивают эту систему, то, значит, данную проблему решили.

Ну и, конечно, с этой системой весь этот убогий "Суеверный чебурнет" накрывается одним интересным местом. Я, правда, почти уверен в том, что никакой Чебурнет они не сделают, потому что делать ничего не умеют, а кроме того, наверняка разворуют процентов 80 бюджетных миллиардов, но даже если что-то сделают - со Starlink это все теряет всякий смысл. Они, конечно, снова вбухают миллиарды во всякие глушилки, но эффективно глушить глобальный интернет, как мне кажется, невозможно.

Все это более чем захватывающе, будем наблюдать.

Ну, в общем, как и ожидалось, внесение компании Huawei в черный список в США привело к огромной куче проблем. Компания Google первой объявила, что останавливает бизнес с Huawei. Чем это чревато? Насколько я понимаю, это означает то, что с этого момента все имеющиеся смартфоны Huawei перестанут получать новые версии Android (что, замечу, совершенно несмертельно), а все будущие смартфоны будут поставляться с Андроидом (это платформа с открытым кодом), но без приложений Google, включая Google Play. И это, конечно, катастрофа для европейского и американского рынков Huawei. Ну да, на самом деле сервисы Google и Google Play на смартфон можно установить самостоятельно и для этого достаточно скачать комплект и запустить его, как энтузиасты делают на телефонах с китайскими прошивками. Но подобными плясками с бубном будут заниматься единицы, остальные просто перестанут покупать смартфоны Huawei, если ничего не изменится.

В Huawei уже достаточно давно ведется разработка их собственной мобильной платформы - условно говоря, KirinOS. Возможно, что они начнут продавать смартфоны на своей платформе. Но даже если там будут все необходимые базовые приложения и все соответствующие облачные сервисы (а у компании свои облачные сервисы уже хорошо развиты), то это никак не сподвигнет пользователей лишиться любимых приложений из Google Play. Впрочем, черт его знает: подобные крупные торговые войны нередко приводят к тому, что рынок быстро переделывается.

Qualcom также заявил, что перестанет продавать Snapdragon Huawei. Но в Huawei заявили, что просто целиком перейдут на свои однокристальные системы Kirin, которыми давно оснащаются многие устройства компании.

Но тут грянул следующий гром - британский разработчик чипов ARM объявил о полной остановке сотрудничества с Huawei (англ.). А это серьезный удар. Потому что многие чипы компании Huawei разработаны с использованием технологий ARM, за использование которых компания платила ARM. Теперь она не сможет их использовать при разработке новых чипов Kirin (для смартфонов-планшетов), Kunpeng (используются в серверах для облачных вычислений), Tiangang (основа базовых станций 5G) и других.

Насколько известно, собственной замены разработок ARM у Huawei пока нет, хотя разработки наверняка ведутся.

Какие компании еще останавливают сотрудничество с Huawei? Как минимум Broadcom и Intel - не видать теперь Huawei процессоров Intel для своих ноутбуков. Равно как и лицензионной Windows, потому что Microsoft наверняка также разорвет сотрудничество. Впрочем, рынок ноутбуков, в отличие от рынка смартфонов, где Huawei сейчас занимает второе место в мире, у них очень маленький. А вот рынок интернет-серверов, насколько я знаю, очень большой.

Что в ответ на это заявляет глава Huawei Жэнь Чжэнфэй? Ну, судя по всему, он прогибаться не собирается - цитирую из "Ленты":

Huawei заявила, что готова к введенным со стороны США ограничениям, а внесение в черный список компаний, которым запрещено сотрудничество с резидентами США без специальной лицензии от властей, сильно не отразится на работе. Такое заявление сделал основатель Huawei Жэнь Чжэнфэй на пресс-конференции, говорится в сообщении пресс-службы компании, поступившем в редакцию «Ленты.ру».

По его словам, самое главное для компании — хорошо делать свое дело. «То, что делает американское правительство, мы контролировать не можем», — сказал он. Жэнь уточнил, из-за действий США темпы роста компании могут немного замедлиться. Бизнесмен отметил, что в первом квартале операционные доходы Huawei по сравнению с аналогичным периодом 2018 года выросли на 39 процентов, в апреле было снижение до 25 процентов. «Возможно, к концу года опять будет снижение, но до отрицательного роста дело не дойдет. И отрасль от этого не пострадает», — сказал он.

Ну, то есть "Китай наш" и все такое. По крайней мере пока они договариваться не собираются, то есть будут очень нешуточные торговые войны. Ну что ж, понаблюдаем.